社区 发现 AI Seedance 2.0 +LibTV ...

Seedance 2.0 +LibTV Skills 一键复刻爆款产品视频

你做出自己的第一条AI视频了吗?

过去做一条产品视频:

需要产品、运营、拍摄团队一轮轮的沟通;

拆脚本、写分镜、寄样品,拍摄素材、剪辑、调整节奏;

加上几千块钱的拍摄/制作成本。

今天就用Lovart刚推出出的无限画布工作流产品:LibTV

给大家演示如何十几块的成本,一句话复刻爆款视频!

LibTV 是 Lovart推出的首款专业 AI 视频创作产品,集成了Seedance 2.0、HappyHorse、Gpt image 2.0等顶级视频图片和模型,一个产品同时适配创作者和AI Agent

对创作者来说,它是一套专业的视频创作工具,足以容纳整个 AI 视频创作流程,你可以在无限画布上搭建剧本、分镜、镜头和剪辑流程,像排练电影一样组织整个创作项目。

对于 Agent 来说,它有很多打包好的、可以直接调用的专业创作能力,通过 Skill 接口理解任务、调用模型、编排工作流并自动完成创作。

Libtv Skills一句话生成45s产品视频

拥有小龙虾Openclaw、Codex、Claude Code等任意Ai Agent

注册Libtv,并安装Libtv Skills

找到参考视频,发送产品图片+一句话提示词,发送给你的Agent,“能复刻这个视频,给我的产品Lib耳机做一个宣传片吗?”

坐等视频生成,45s产品宣传视频搞定

一句话生成背后是什么?

为什么效果会比直接用Seedance生成的视频效果好?

一句话的背后,其实是一个完整的爆款视频复制工作流

分析原产品视频 -> 拆解脚本 -> 写分镜-> 根据生成素材 -> 生成各分镜视频 -> 自动剪辑 -> 45s成片

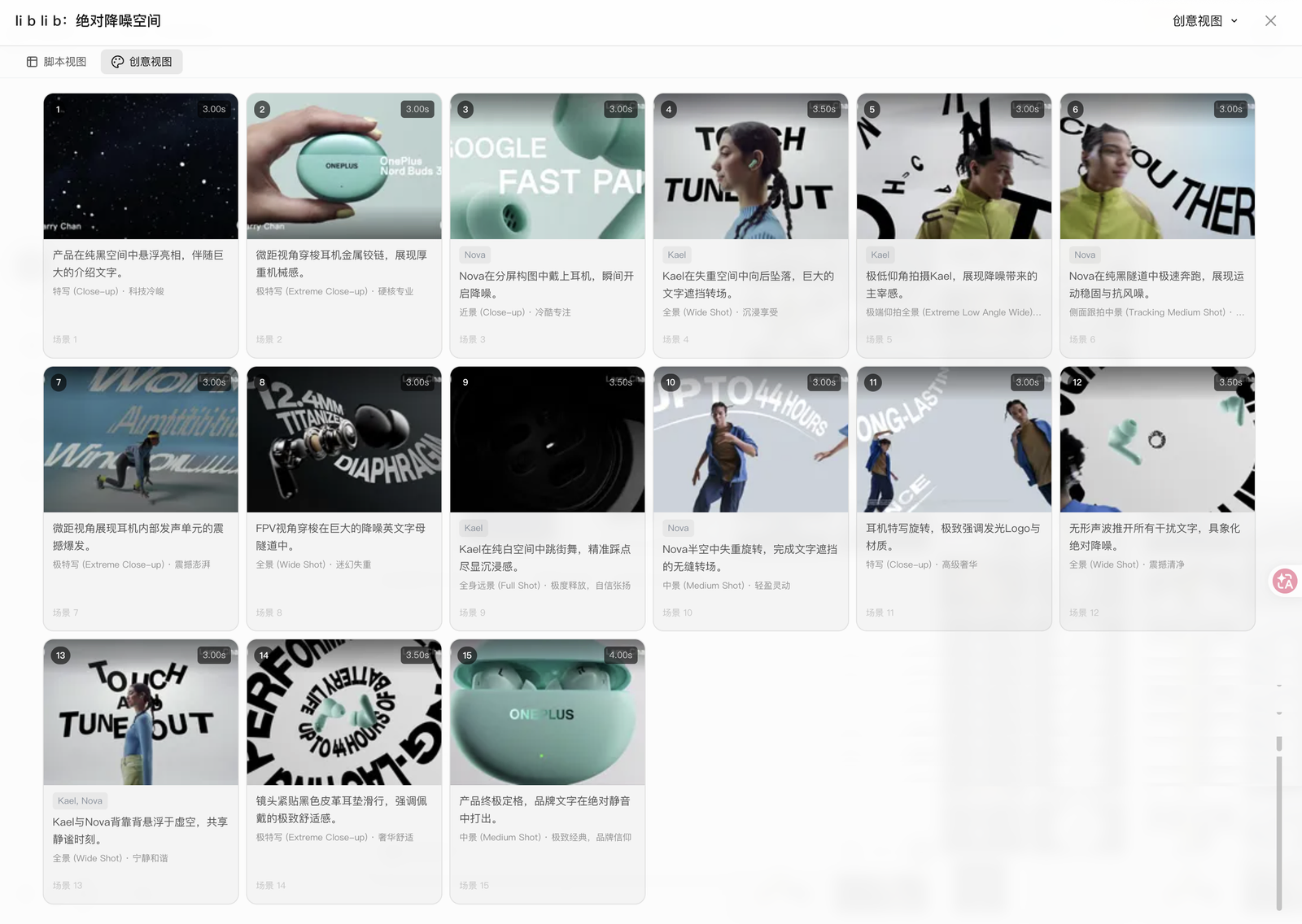

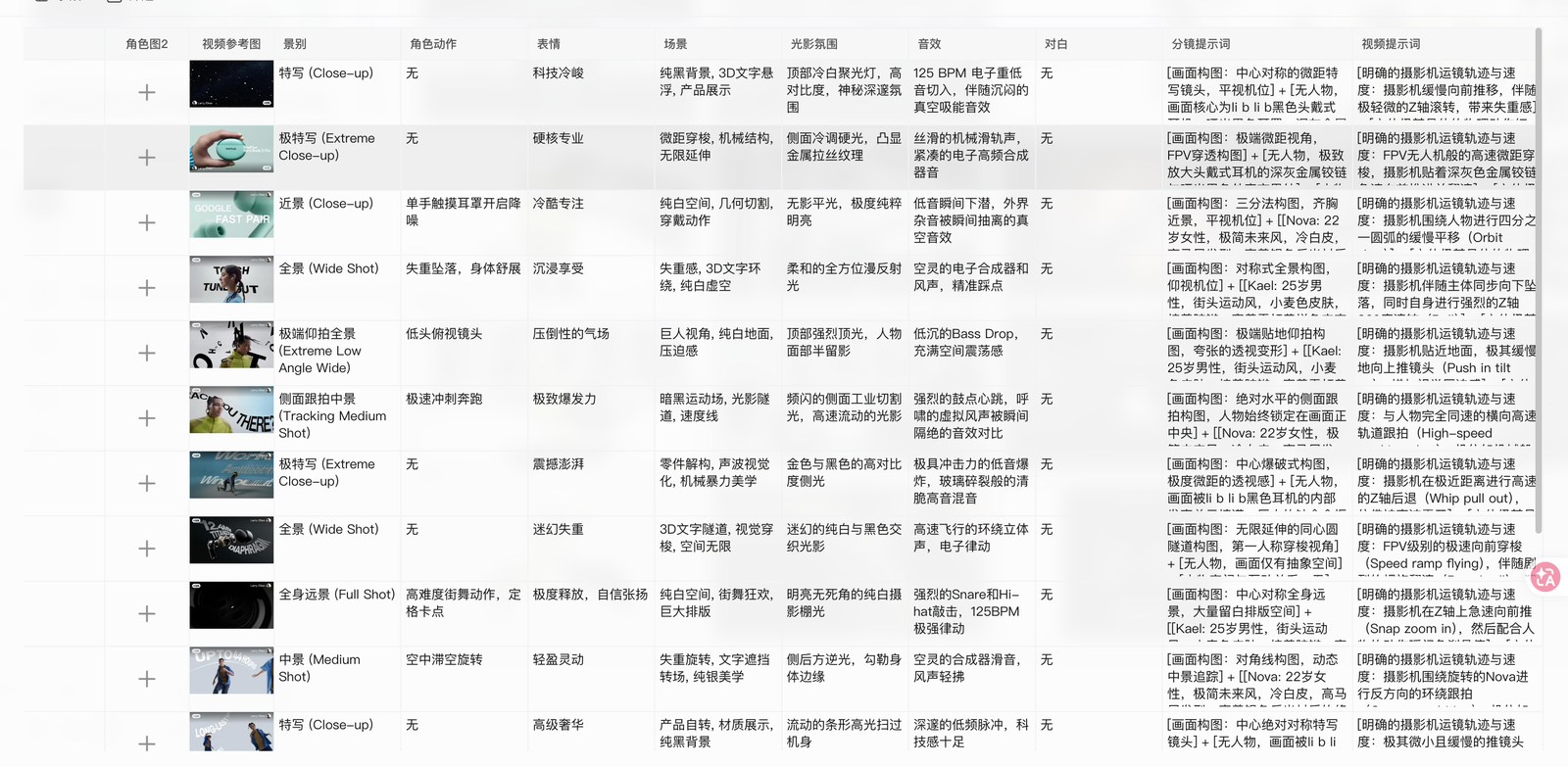

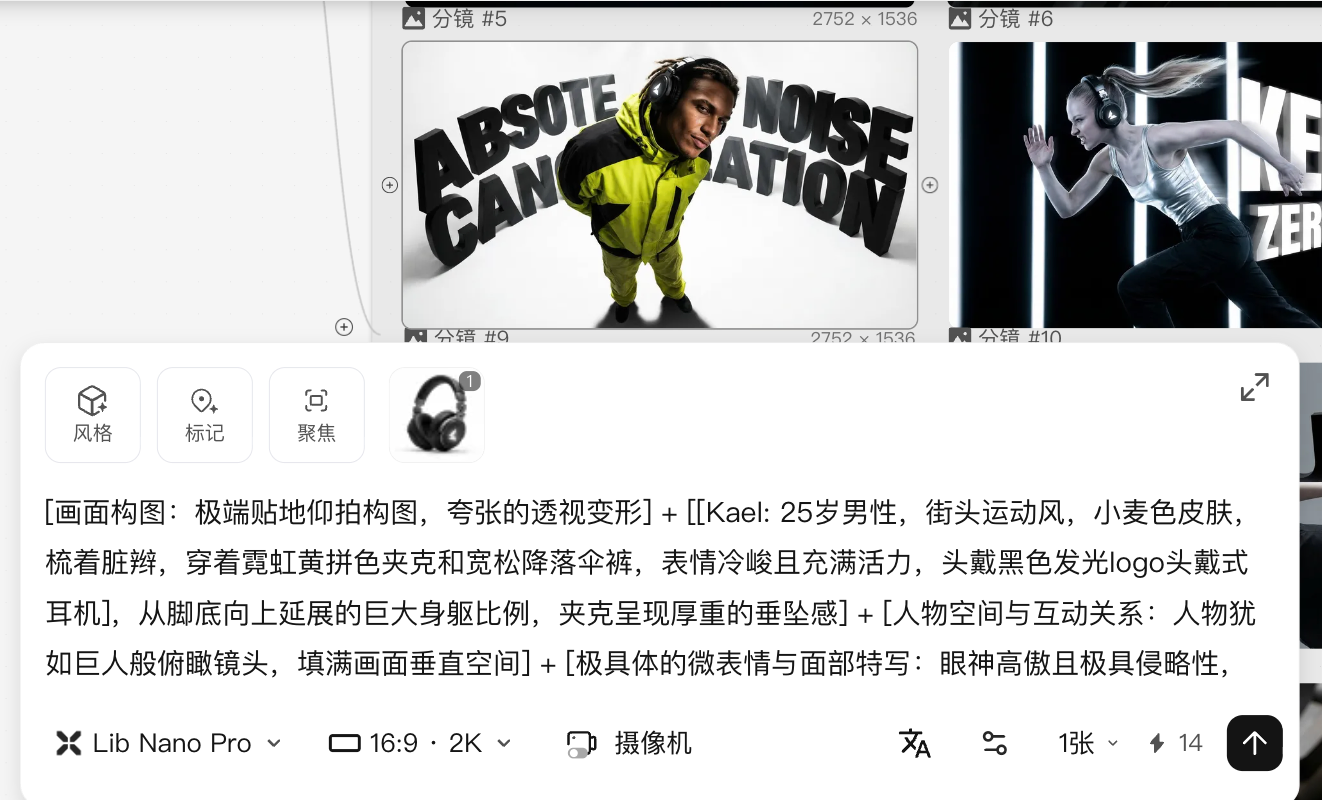

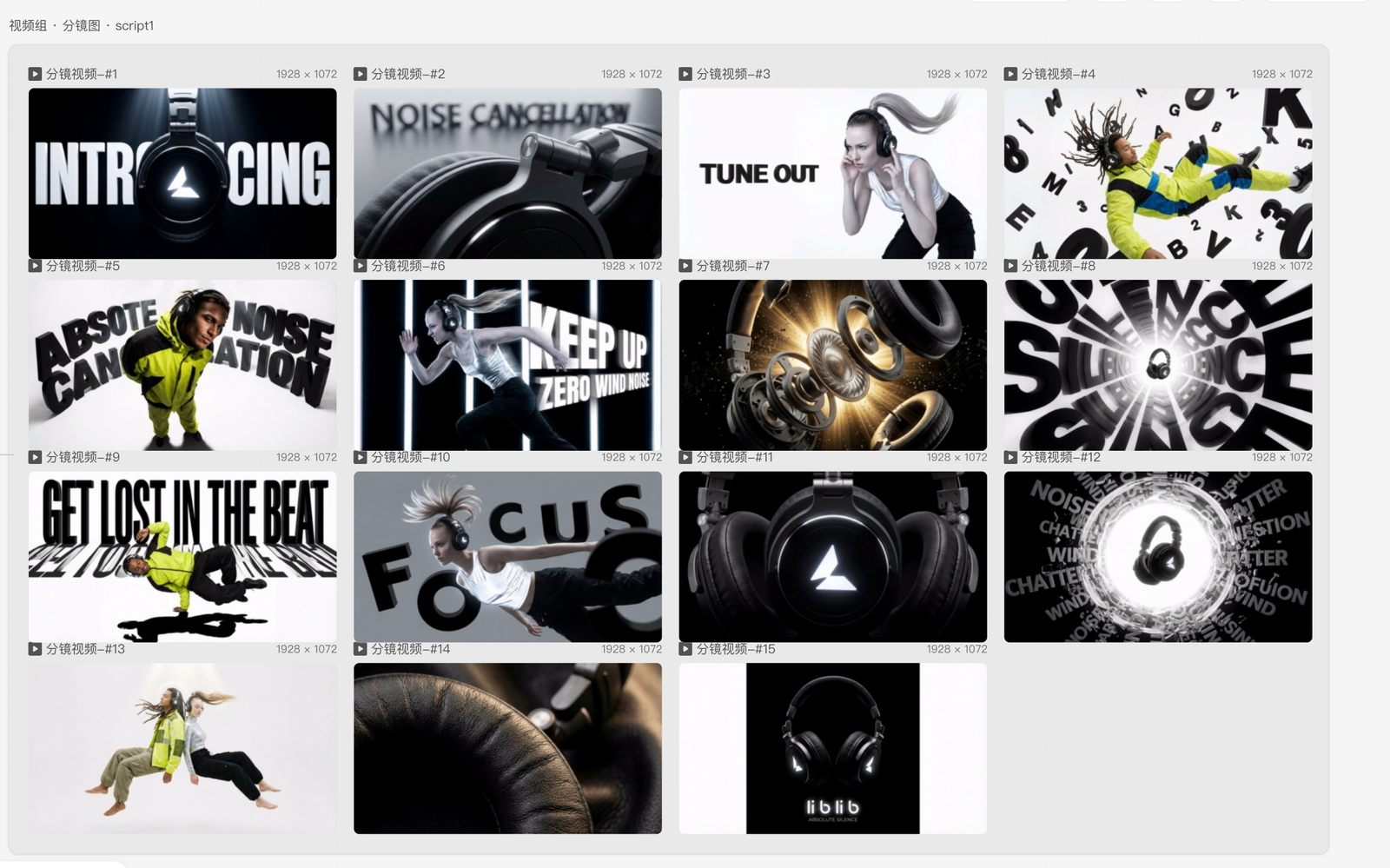

1. 拆解原视频为15个3s视频分镜,分析表达、脚本、镜头

2. 根据视频分析结果,生成产品视频脚本

3. 根据脚本,结合爆款视频参考图,和产品图,自动生成分镜素材图片的提示词 + 分镜视频的提示词,包括不限于场景、光影、音效、对白

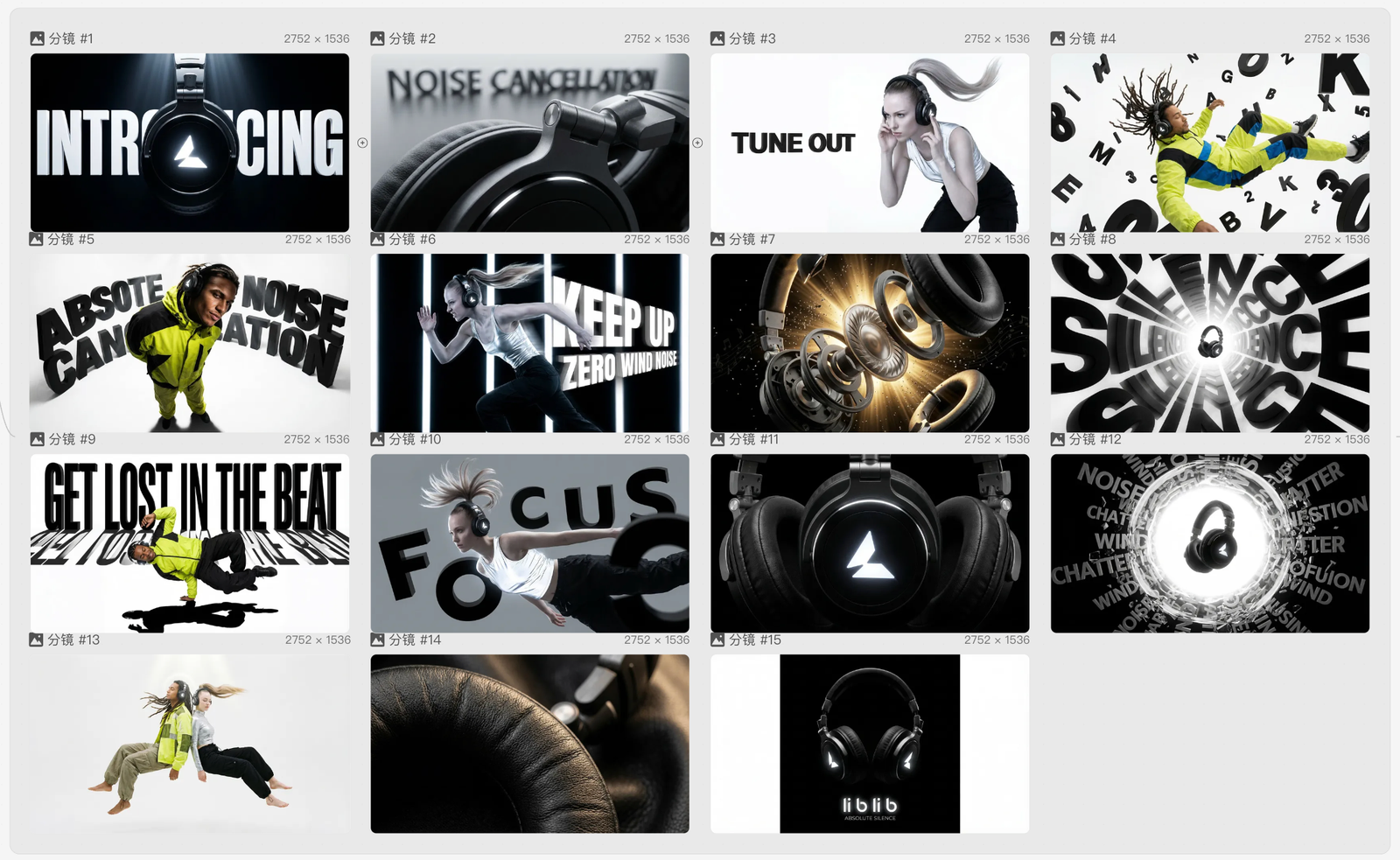

4.根据生成的提示词,调用图片模型,批量生成15张分镜素材

5.每一张分镜图背后都是完整的参考图+提示词

6. 根据素材+视频提示词生成15个3s分镜视频

7. 自动剪辑+配音,生成完整产品视频

所以,AI视频到底意味什么

在25年11月的一个分享,当时的视频生成能力还远不如Seedance或者happy horse、随着模型能力越来越强,工具越来越好用:

1、现在能做的视频,多快好省

2、现在实拍做不到/成本能力不允许

3、AI 视频不是用来硬替代所有真人实拍,而是用来解决那些创意表达强、概念感强、风格感强、但对真实一致性容忍度相对高的场景。

AI 迭代的速度,有目共睹,从前几年复杂的 sd、Midjourney,各种花哨的提示词,到现在一句话出片的 Nano banana?、Seedance,图片和视频内容的生产效率、质量、难度、成本都越来越低。

效率? ✖️ 成本⬇️ ✖️ 质量?,生产成本无限趋近于 0,内容很快就会进入无限供给的时代,那显然不会只是以一个降本增效的故事和规则。

我们做个假设:从明天开始,所有人都能用 AI 在 5 分钟内生成 80 分的产品主图和视频素材这时候会发生什么?

两个新机会?

当内容供给无限,真正稀缺的不再是“内容”本身,而是:

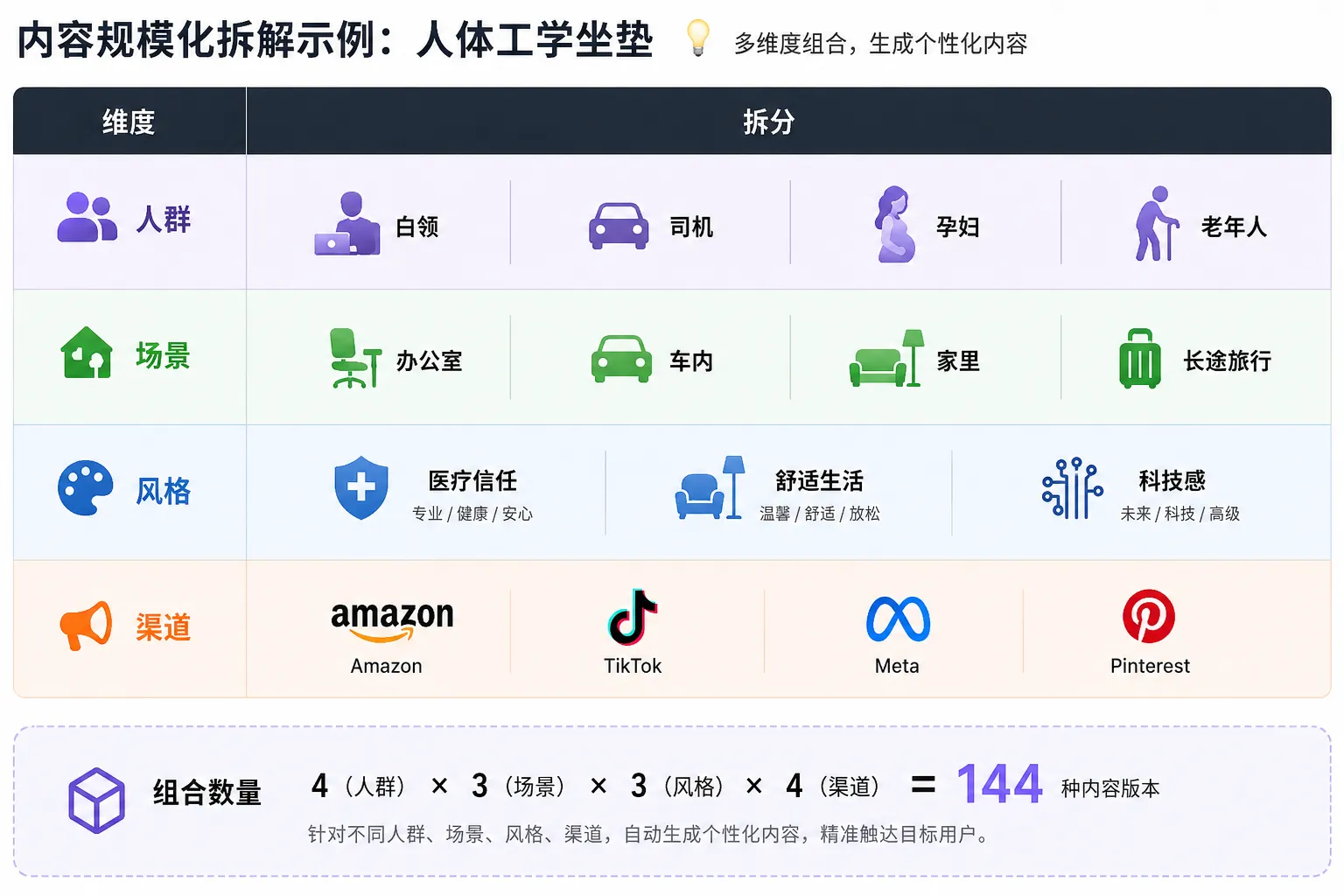

机会 1:多场景 × 多人群 × 多渠道:个性化内容的规模化SP 视频

过去的困境:

内容 = 标准化生产

一个产品 → 一套素材 → 所有人看一样

现在:

内容 = 按人群动态生成

一个产品 → 多人群多版本 → 精准匹配

内容从“静态资产”变成“动态系统”

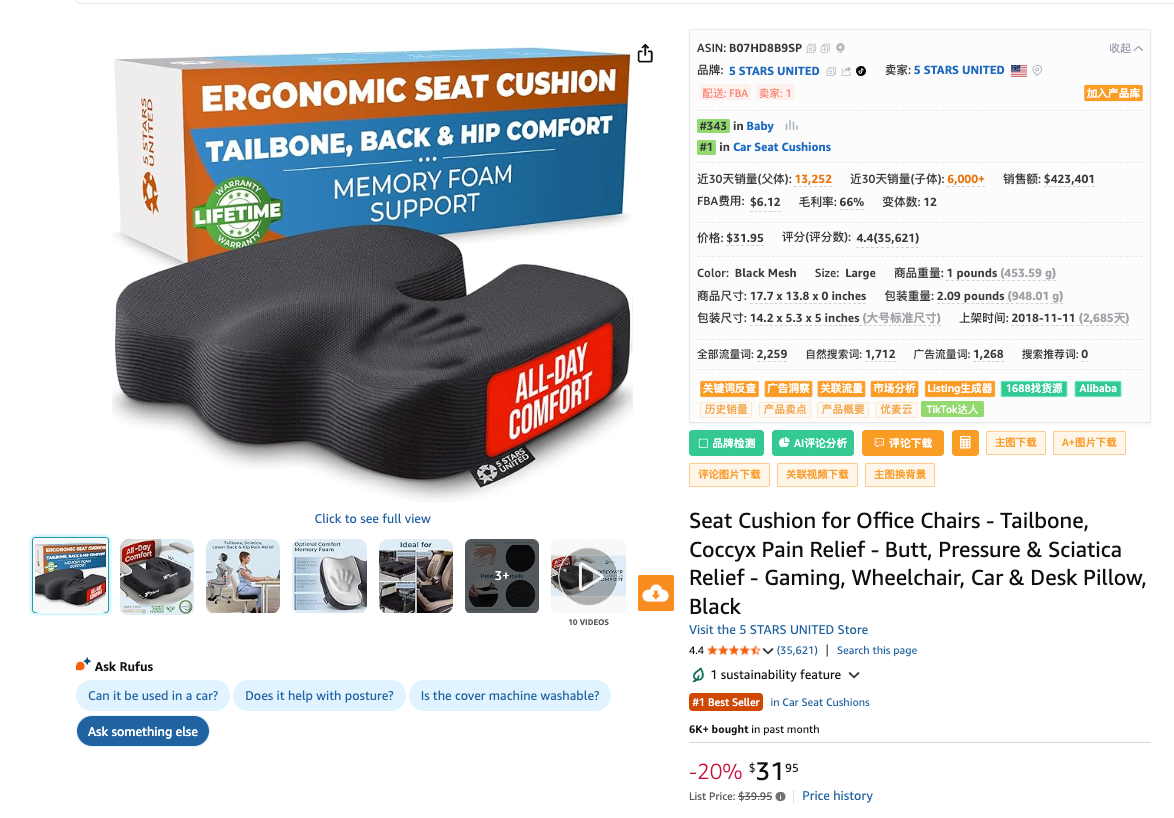

举个例子:人体工学坐垫(Ergonomic Seat Cushion)

这个选品是刻意挑的,有几个优点:

多人群:办公室人群 / 司机 / 孕妇 / 老年人

多场景:办公 / 开车 / 居家 / 长途旅行

多情绪:疼痛缓解 / 舒适 / 健康 / 专业感

4 × 3 × 3 × 4 = 144 种内容版本

1、建立「人群 × 场景 × 风格」映射表

2、为每一类组合准备 Prompt 模板

3、批量生成内容

4、分渠道分人群投放

内容匹配的精准度和效率提升

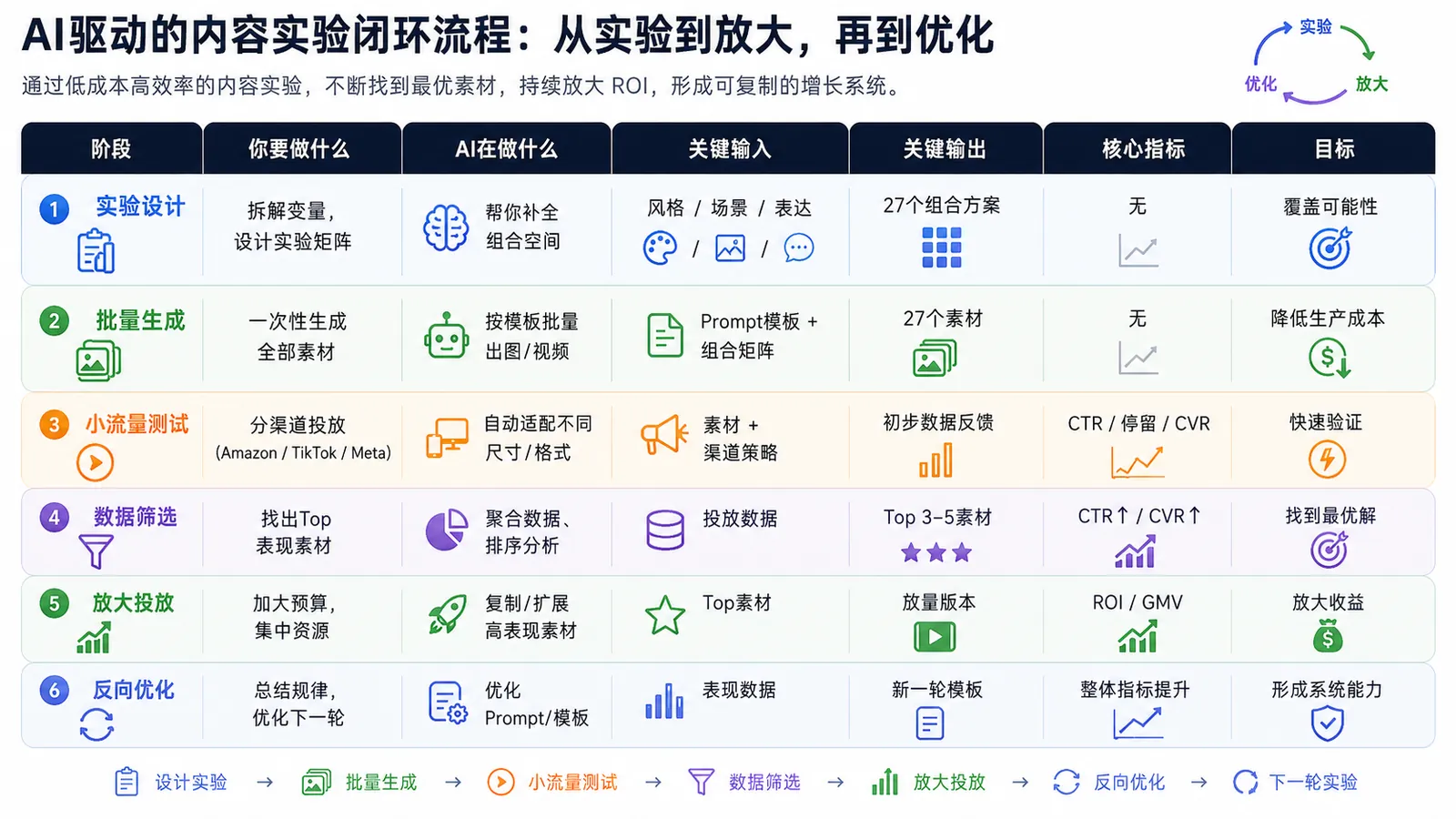

机会 2:创意驱动->实验驱动:内容实验的成本归零,人人可以数据驱动

本质变化

过去:

一个创意 = 几百到几千成本

做错一次 = 浪费钱 + 时间

决策靠经验

现在:

一个创意 = 几毛钱 + 几分钟

可以同时测试几十种方案

决策靠数据

从“创意驱动” → “实验驱动”

1、设计实验矩阵(风格 × 场景 × 表达)2、批量生成全部组合

3、小流量测试

4、数据筛选 → 放大

5、反向优化 Prompt

这一层的本质:决策方式升级(经验 → 数据)

倒计时:

倒计时:

0 个回复